Die Digitalisierung der Gesellschaft beschränkt sich nicht auf Smartphones, sondern zeitigt mit Impulsen wie der Automatisierung der Mobilität, der smarten Steuerung unserer Energieversorgung und der Industrie 4.0 umfassende Transformationseffekte in ganz verschiedenen Bereichen. Auch wenn wir es im Horizont des Digitalen gewohnt sind, eher im Sinne des „Höher, Weiter und Schneller“ zu denken, was sich exemplarisch an den Anforderungen an Datenmengen und den Raten ihrer Übertragung zeigt, so gibt es auch Anwendungsbereiche, die sich an gegenläufigen Imperativen orientieren.

Die Idee der Nachhaltigkeit findet einerseits zunehmend Verbreitung, was sich u.a. in dem Verständnis von Energie als wertvoller, nicht unendlich verfügbarer Ressource bekundet, andererseits ist die unreflektierte Verschwendung von Energie gewiss noch immer ein Thema, das sich in verschiedenen Bereichen wie der Nutzung von generativer künstlicher Intelligenz manifestiert. Neben dem gesamtgesellschaftlichen Horizont gibt es allerdings auch viele andere Motive, mit Ressourcen wie Energie oder Daten bewusst und effizient umzugehen

Technologien, die sich zum Beispiel eher an Prinzipien der Energieeffizienz ausrichten, sind dabei schon heute von Nutzen: Neben den Zahlungen per Bargeld sind EC Karten, Smartphones und Smartwatches mittlerweile als Zahlungsoption im Alltag weit verbreitet. Auch wenn diese Zahlweise rein äußerlich recht simpel wirkt, beruht sie auf komplexen Technologien, die zugleich die notwendige Sicherheit verbürgen. Die Energieeffizienz ist hierbei ein wichtiger Aspekt, der die sichere Kommunikation im Nahbereich ermöglicht.

Was ist die Nachrichtentechnik?

Mit der Frage, wie Informationen übertragen werden, befasst sich die Elektrotechnik, genauer das Gebiet der Nachrichtentechnik. Kurz gefasst geht es hierbei um die Gewinnung, Umwandlung, Übertragung, Vermittlung, Speicherung und Ausgabe von informationstragenden Signalen. Im Fokus steht das Ziel, möglichst unverfälschte Informationen zu übermitteln, wobei die Herausforderungen hierbei ebenso beim Aus- wie beim Eingang der Signale wie bei dem Übertragungsweg und dem Umgang mit Störungen liegen. Anders formuliert lässt sich dies als Bereich der Informations- und Kommunikationstechnik im Sinne der technischen Infrastruktur einer digitalen Gesellschaft begreifen.

Das Betätigungsfeld dieser ingenieurwissenschaftlichen Disziplin hat sich im Zuge des Wandels von der Analog- hin zur Digitaltechnik erheblich aufgefächert. Zugleich ergeben sich mit dem Entstehen der modernen Informationsgesellschaften genuine Herausforderungen, die verschiedene technologische Lösungsansätze bedürfen. Einerseits meint dies den Aufbau einer leistungsfähigen Netzinfrastruktur, wie sie viele Bereiche benötigen, zum Beispiel die autonom agierende Logistik. Die Unmengen an Daten und ihre notwendige Verfügbarkeit (sowie Verarbeitung) in Echtzeit verlangt eine optimale Nutzung der Übertragungstechnologien, Kanalkapazitäten und Bandbreiten, um die Kommunikation zu ermöglichen. Andererseits gibt es Anwendungsfelder wie die erwähnte Zahlung über EC-Karten, Schlüsselkarten (u.a. beim Car-Sharing), in deren Fokus die Authentifizierung und die Sicherheit stehen und dies mit einem geringen Energieverbrauch verbinden.

Signal-Rausch-Abstand

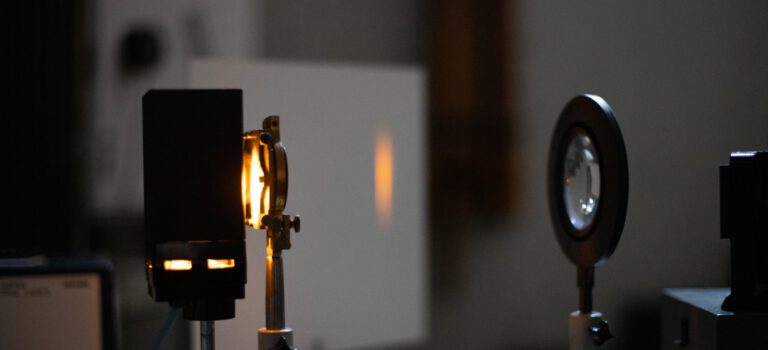

Das allgemeine Ziel in der Nachrichtentechnik ist die Übermittlung von Informationen, indem ein Signal möglichst störungsfrei von Sender zum Empfänger gesandt wird. Ein relevanter Faktor ist hierbei der Signal-Rausch-Abstand: Je größer der Abstand, um so distinkter nimmt sich der Unterschied zwischen dem Signal und störenden Einflüssen, zum Beispiel von überlagernden Umgebungsgeräuschen, aus, wodurch die Informationen klarer empfangen werden können. Um diese Beeinträchtigungen des Signals zu minimieren, gibt es zwei Wege: Ein Ansatz besteht in der Reduktion bzw. Filtern der Störgrößen. Der andere klassische Weg besteht in der Verstärkung des informationstragenden Signals. In beiden Fällen wir der Signal-Rausch-Abstand vergrößert und das erwünschte Signal deutlicher.

Zu bedenken ist, dass je nach Verstärkung der Leistungsaufwand und damit der Energiebedarf steigt. Gerade in Anwendungsfällen, in denen Energie nur sehr begrenzt zur Verfügung steht, muss dieser Faktor folglich miteinkalkuliert werden. Je nach Anwendungsgebiet ist es mithin eine Abwägung, welches Instrument geeigneter erscheint. Der adaptive Umgang mit Gegebenheiten und Problemstellungen ist eine ingenieurwissenschaftliche Grundkompetenz, die auch im Bereich der Nachrichtentechnik zum Tragen kommt.

Zwischen Effizienz und Signalstörungen

Für spezifische Anwendungsfälle ist die Minimierung des Energieaufwandes zur Datenübertragung notwendig, wofür angepasste technische Lösungen gefunden werden müssen. Einer dieser Fälle ist die Steuerung von Rovern in extraterrestrischen Umgebungen, aber es gibt auch weit irdischere Anwendungen. Professor Ralf Martin Kramer stellte im Rahmen seiner Antrittsvorlesung einen neuen Ansatz der Datenübertragung vor, der den speziellen Anforderungen einer Datenübermittlung mit minimalen Energieaufwand genügt, wobei dieses Thema auch im Zentrum seiner Dissertation stand. Seit Oktober 2024 hat Dr.-Ing. Kramer die Professur „Elektronische Schaltungen“ an der Fakultät für Elektrotechnik der Hochschule Schmalkalden inne.

Bleiben wir zunächst bei der Informationsübertragung: Um eine sichere Informationsvermittlung bei nicht allzu hohem Energieaufwand zu gewährleisten, ist es möglich, dass sich Sender und Empfänger auf bestimmte Sequenzen einigen. Das heißt, die Signale bestehen nicht nur aus einzelnen Informationen, sondern aus Zeichenketten, die dann für eine Information stehen. Ein Beispiel ist das NATO-Alphabet, in dem Charly für C steht: Käme nur arly als Information an, wäre dennoch klar, dass C gemeint ist. Zwar ist dies ein unnötiger Overhead – also ein informationeller Mehraufwand –, bei gestörten Übertragungen und fehlenden Fragmenten in der Übertragung ist dies aber ein Weg, die Übermittlung zu verbessern. So kann ein gewisser Grad des Rauschens akzeptiert werden, zugleich ist aber eine gewisse Rechenleistung durch die Interpretation des Eingangs ebenso notwendig wie die Kenntnis der Codierung bei Empfänger und Sender.

Radio Frequency Identification

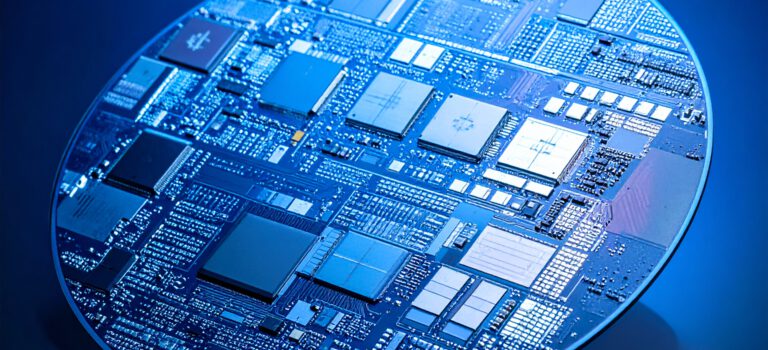

Eine andere Variante ist Sigma Shift Keying (SSK), der wir uns gleich zuwenden. Kurz gefasst ist dies eine Übertragungstechnik, der Ansätze des RFID zugrunde liegen und variiert werden. Was ist RFID? Grundsätzlich meint dies die Radio Frequency Identification und ist eine Technologie zur automatischen, kontaktlosen Identifizierung von Objekten mittels Radiowellen. Neben einem Lesegerät umfasst das System einen Sender-Empfänger (Tag) und erlaubt zugleich die eindeutige Authentifizierung des Tags. Die RFID-Tags sind weitverbreitet, sehr kostengünstig – zumindest in ihrer passiven Version – und erlauben die eindeutige Identifizierung von Objekten.

Es gibt verschiedene Varianten, wobei die grundlegende Funktion vergleichbar bleibt: Die Leseeinheit baut ein hochfrequentes Feld auf und aktiviert so den Tag. Je nachdem gibt der Tag nur die Information seiner Anwesenheit zum Zwecke der Identifizierung zurück, weitere Daten oder nimmt vom Lesegerät gesandte Daten auf. Der Tag kann passiv sein, also ohne eigene Stromversorgung, wobei er hierbei seine Energie vom Feld des Lesegerätes entnimmt. Durch diese Einschränkung ist der Funktionsumfang dieser Tags gering. Aktive Tags sind mit einer Batterie versehen, wodurch sie mit effizienten Sensoren ausgestattet werden können, deren Messungen sie zum Beispiel an das Lesegerät weitergeben können. Zudem können sie Berechnungen selbstständig vornehmen.

Software Defined Radio

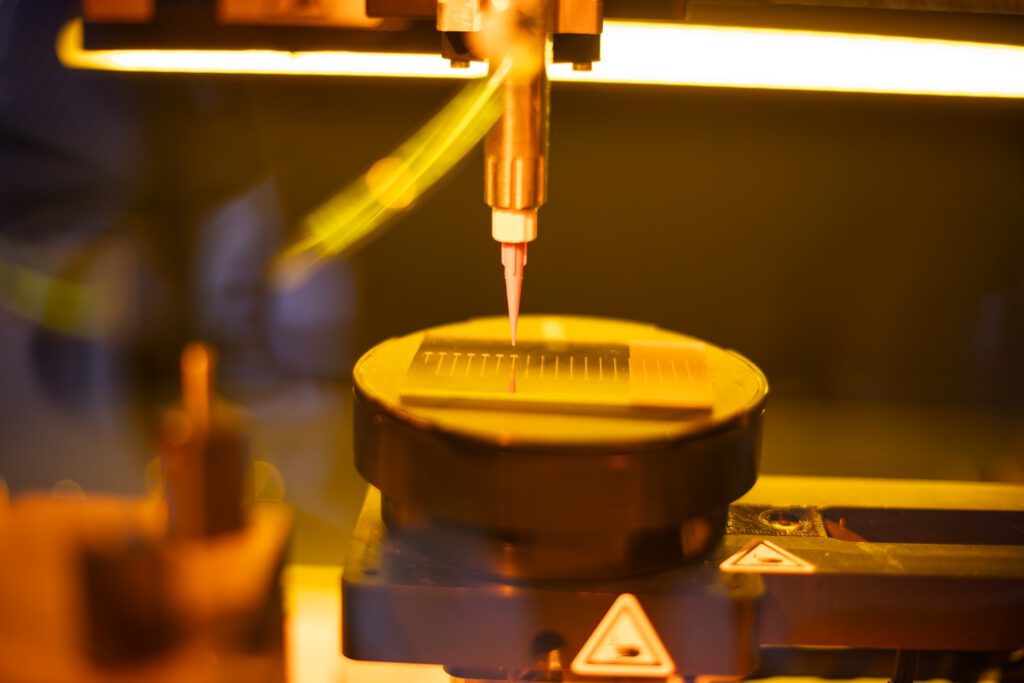

Bevor wir zum SSK kommen, muss noch eine zweite technologische Komponente eingeführt werden, die eine weitere Grundlage des SSK bildet: Das Software Defined Radio. Kurz gefasst geht es hierbei um ein Kommunikationssystem über Radiowellen, bei dem die analoge Hardware durch eine auf einem integrierten Computer befindliche Software ersetzt wurde. Vormals hardware-basierte Komponenten der analogen Signalverarbeitung wie Selektion und die Modulation/Demodulation werden nun über eine digitale Signalverarbeitung geleistet. Bedingung hierfür ist die gewachsene Leistungsstärke der Chips. Vorderhand bieten Softwarelösungen den großen Vorteil einer bleibenden Flexibilität und Anpassungsfähigkeit, die fixierte, analoge Formen nicht aufweisen können. Zum Beispiel ist dies eine Grundlage der mobilen Telefonie: Der ständige Wechsel von einer Funkzelle in eine andere und die sich dabei verändernden Funkprotokolle (Regeln, Syntax, Semantik und Synchronisation des Datenaustauschs) wären mit analogen Apparaturen kaum realisierbar.

Mit den jüngsten technologischen Entwicklungssprüngen in der Rechenleistung und der Verfügbarkeit kostengünstiger Komponenten wie digitalen Signalprozessoren fand auch die SDR-Technologie im nicht-militärischen Sektor Verbreitung. Ein Beispiel sind die DVBT-Empfänger in USB-Sticks, in denen SDR-Komponenten verbaut sind. Wie nutzt nun SSK das SDR? Das SSK benötigt gewisser mathematischer Modelle und Berechnungen, um die Signale zu Detektieren und zu Synchronisieren. Diese Operationen können jedoch auf Algorithmen reduziert und in Form von Software auf den Empfängern hinterlegt werden. Das SSK-System bleibt in der Folge möglichst leicht und anpassungsfähig an verschiedene Anwendungsfelder und Berechnungsmodelle.

Sigma Shift Keying

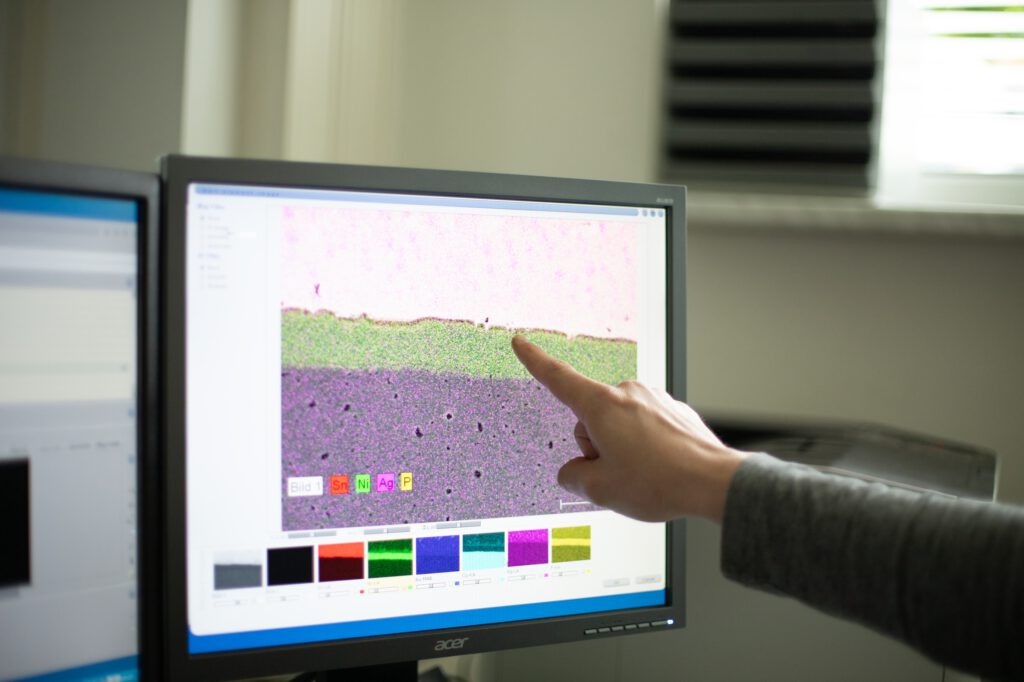

In natürlichen Umgebungen gibt es ein unvermeidliches Grundrauschen. Dieses Rauschen ist eine echte stochastische Größe, also ein Zufallsprozess, der als solcher nicht prognostizierbar ist. Anders als im üblichen Umgang der Nachrichtentechnik wird dieses Rauschen im SSK akzeptiert und zum Beispiel als die binäre Null gesetzt. Der zweite zur Übertragung notwendige binäre Zustand „1“ wird durch eine gezielte Änderung des Rauschens herbeigeführt. Hierbei besteht die Möglichkeit zusätzliches Rauschen hinzuzufügen, oder alternativ eine Reduktion des vorhandenen Rauschens vorzunehmen. In beiden Fällen wird eine Unterscheidbarkeit der beiden Signale, also des Grundrauschens und des informationstragenden Signals, im Sinne von Rauschniveaus eingetragen. Auch wenn also die stochastische Größe des Rauschens selbst unberechenbar bleibt, lässt es sich so verändern, dass es Informationen übertragen und von einem Lesegerät aufgenommen werden kann. Das Rauschen, dass bislang einzig als Problem in der Nachrichtentechnik aufgetreten ist, kann so selbst zur Übertragung genutzt werden.

Gerade die Absorption hat den Vorteil der Energieeffizienz, da hier kein eigenes Feld aufgebaut werden muss, sondern ein vorhandenes genutzt wird. Dahinter steht das bereits in der Messtechnik bekannte Prinzip der Lastmodulation. Grob vereinfacht wird dabei Energie absorbiert und über einen Widerstand in Wärme verwandelt. Zugleich kann so das Rauschen reduziert werden, wodurch ein kontaktloses Abtasten des Signals möglich wird.

Der technische Aufwand des SSK ist dabei nicht anspruchslos: Gerade die Rückgewinnung der binären Daten aus dem stochastischem Rauschsignal ist eine Herausforderung, wobei die Synchronisation sowie die Detektion zu leisten ist. Für beide Aufgaben wurden bestimmte mathematische Methoden entwickelt, die die Übertragung der Informationen leisten. Der Algorithmus muss also klären, welches Niveau verschiedene Rauschsampels haben und an welchen Stellen Datenpakete beginnen und enden.

Der Vorteil des SSK liegt in Fällen vor, in denen eine kontaktlose Übertragung von Messwerten in geschlossenen Objekten anvisiert wird, die zugleich über längere Zeit gegeben sein soll. Durch den minimalen Energieverbrauch und die angepasste RFID-Technologie ist einerseits die langfristige Authentifizierung möglich, und andererseits durch die Nutzung effizienter, in die Microprozessoren bereits integrierter Sensoren eine Erweiterung der funktionalen Möglichkeiten gegeben. In der Auslegung als Low-Power-Sensoren eignet sich diese Technologie zum Beispiel für spezifische Medizinprodukte, die den inneren Zustand von Paketen überwachen (Druck, Temperatur u.a.).

Forschung und Lehre

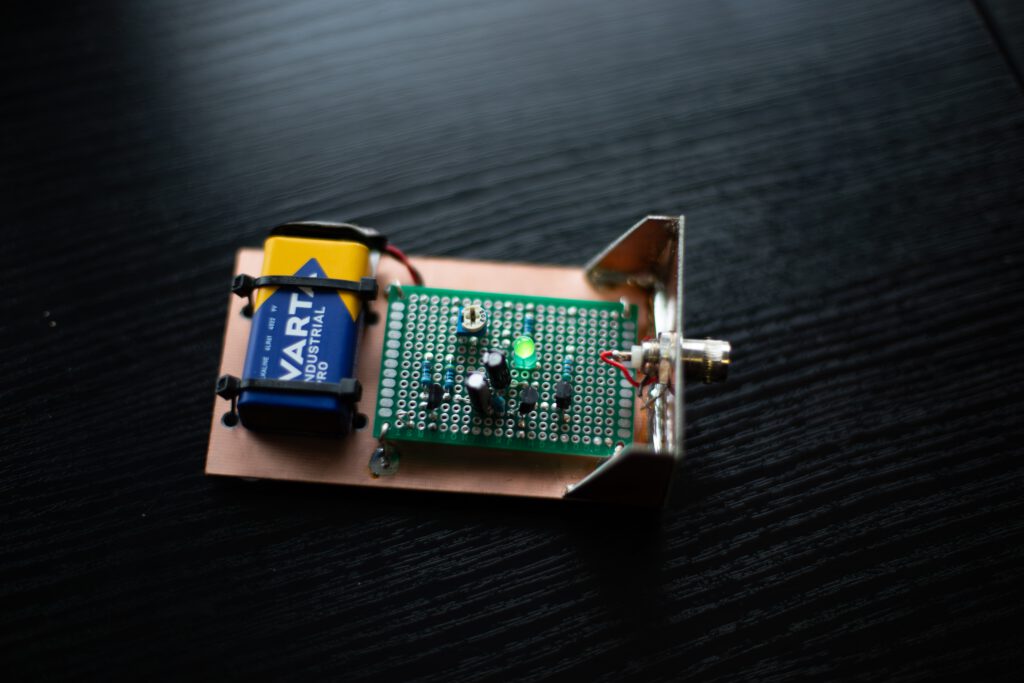

Neben der weiteren Optimierung der Technik und Verfahren ist ein Ziel der Forschung, die SSK-Empfänger auf einer kostengünstigen Hardware zu implementieren, wobei die Reduktion der Kosten einer zukünftigen Verbreitung der SSK-Technologie dienlich sein sollte. Die praktische Umsetzung von SSK im konkreten Anwendungsfall der RFID steht noch in einer frühen Phase der Forschungstätigkeit. Ziel ist es hier eine kostengünstige Lösung in die Praxis umzusetzen.

Neben der RFID Übertragung gibt es aber noch einige weitere andere Anwendungsgebiete, die aber hiervon deutlich abweichen. Durch die Möglichkeit, eine Änderung der Standardabweichung vorzunehmen (daher auch der Name „Sigma“- für die Standardabweichung), also die Umtastung der Standardabweichung, kann auch z.B. eine existierende Funkstrecke um den Parameter der Modulation der Standardabweichung erweitert werden. Kurzum können so zusätzliche Daten können zu den bereits existierenden Datenkanal übertragen werden.

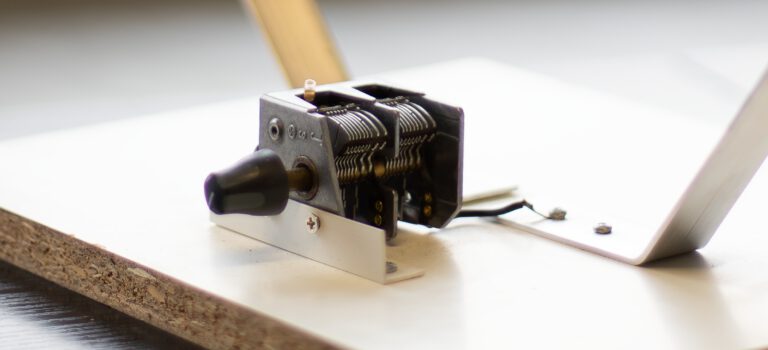

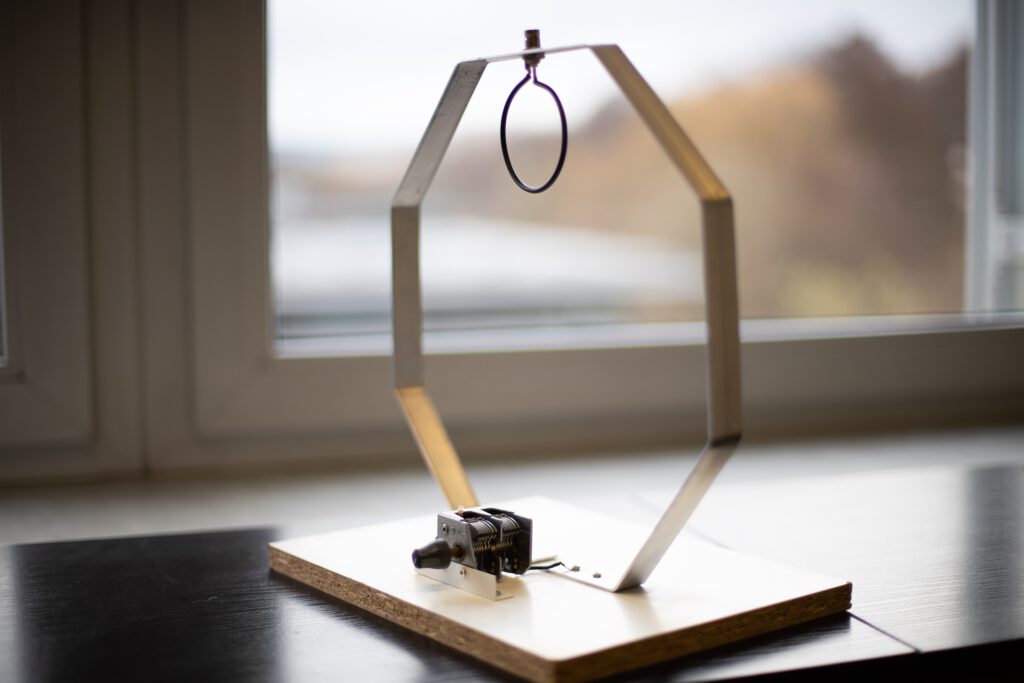

Mit einer angetretenen Professur verbinden sich jedoch nicht nur Aspekte der Forschung, sondern auch der Lehre, mithin der Vermittlung von Wissen und Kompetenzen. Just der kreative Umgang mit Problemstellungen im Sinne eines Motors für Innovationen lässt sich als ein Brückenschlag zwischen der Entwicklung des Sigma Shift Keying und der grundlegenden Vermittlung ingenieurswissenschaftlicher Kernkompetenzen deuten, der insbesondere an Hochschulen angewandter Wissenschaften von Relevanz ist. Theorie und Praxis sollen sich demgemäß produktiv verknüpfen, und die Problemlösungskompetenz der Studierenden stärken. Ein Weg der Vermittlung besteht in ambitionierten studentischen Projekten, in denen sich mechanische und elektrotechnische Aufgaben verbinden. Ein Beispiel ist die Konstruktion einer Sortiermaschine, für die verschiedene Gruppen ganz unterschiedliche Wege der Umsetzung gefunden haben. Solche praxisnahen Erfahrungen können die Studierenden dann in ihrem Berufsleben nutzen.