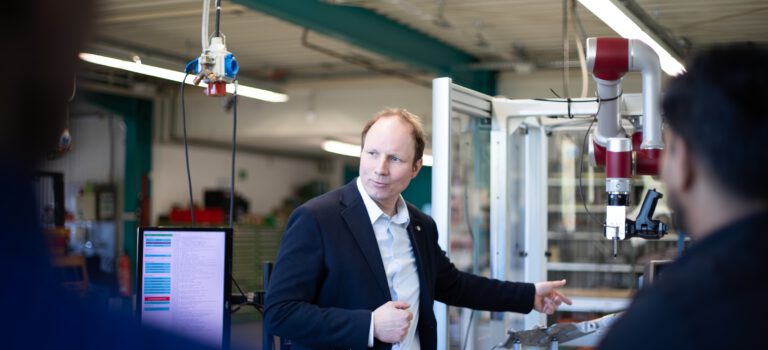

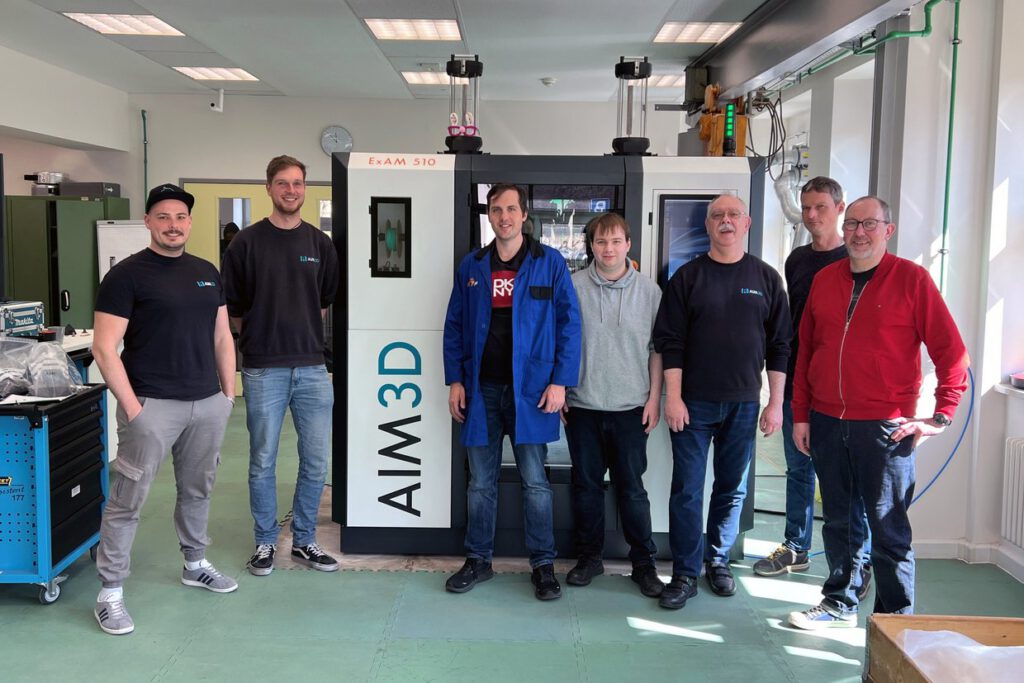

Ende letzte Woche wurde das einjährige Forschungsvorhaben 3D-FMM, welches sich mit der Entwicklung einer modularen und anpassungsfähigen Fertigungsmessplattform beschäftigt, in einem feierlichen Rahmen in den Räumen des Suhler Unternehmens PREMETEC abgeschlossen. Wie eine produktive Kooperation regionaler Unternehmen und Hochschulen angewandter Wissenschaften im Sinne eines wechselseitigen Transfers funktionieren kann, lässt sich am Beispiel dieses Forschungsprojektes studieren.

Das Projekt widmete sich einer konkreten Fragestellung, die aber zugleich ein breites Spektrum möglicher Anknüpfungspunkte eröffnet: Ist es möglich, eine automatisierte Messstation zu bauen, die zugleich kostengünstig, variabel und hochpräzise ist? Innerhalb des Horizontes ließen sich die Projektpartner mit ihren jeweiligen Perspektiven produktiv verbinden: Auf der einen Seite die Hochschule Schmalkalden und hier speziell mit Nikhil Meduri und Niranjan Kannali Ramesha ein Team des Lehrstuhls „Professur für Antriebs-, Automatisierungs- und Robotertechnik“ von Professor Frank Schrödel, und auf der anderen Seite das Suhler Unternehmen PREMETECPREMETEC, einem südthüringischen hidden champion mit einer Expertise für Messtechnik und Prüfanlagen. Eine besondere Problemstellung war dabei die kosteneffiziente Ausrichtung des Projektes, was sich auch in der Nutzung von Low-Cost-Robots manifestierte.

Der Einsatz kollaborativer Roboter nimmt in der Industrie immer mehr Fahrt auf: Im Unterschied zu vollständigen Automatisierungen wird hier ein Schwerpunkt auf der Zusammenarbeit von Mensch und Maschine gelegt, was Herausforderungen für die Interaktion, die Kommunikation und die Sicherheit im Zusammenspiel von Roboter und Mensch birgt. Cobots können bei repetitiven Aufgaben wie Montage, Pick-and-Place oder Qualitätskontrolle helfen und industrielle Arbeitsabläufe optimieren. Zudem sind sie leicht zu programmieren und bieten einen hohen Grad an Entlastung und Arbeitsschutz. Für viele Anwendungsfälle der Industrie eignen sich kollaborative Lösungen, wobei sich das Angebot an verschiedenen Modellen von Cobots mehr und mehr erweitert. Neben hochpreisigen Varianten gibt es auch kostengünstige Modelle, die sich grundsätzlich einfachen Aufgaben erfüllen, bei denen aber Abstriche bei manchen operativen Qualitäten (wie der Geschwindigkeit) gemacht werden müssen.

Im Horizont der weiter voranschreitenden Automatisierung der industriellen Produktionsprozesse stellt sich die Frage, ob und sie sich Low-Cost-Coboter für spezifische Aufgaben nutzen lassen. Oder anders: Wie diese lassen sich kostengünstige kollaborative Roboter technologisch so ertüchtigen, dass sie hochpräzise Messoperationen vollführen können? Bevor wir uns dieser Frage und seiner Lösung widmen, braucht es noch ein paar Worte über PREMETEC und die Herausforderungen hochpräziser Messtechnologien.

Messtechnik zwischen Präzision und Flexibilität

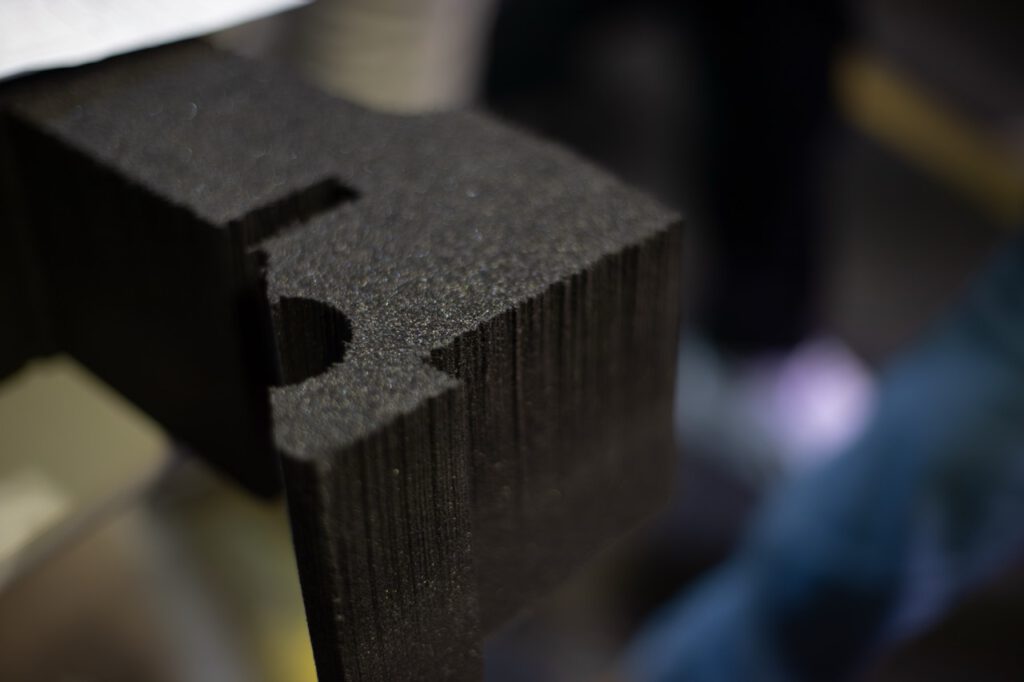

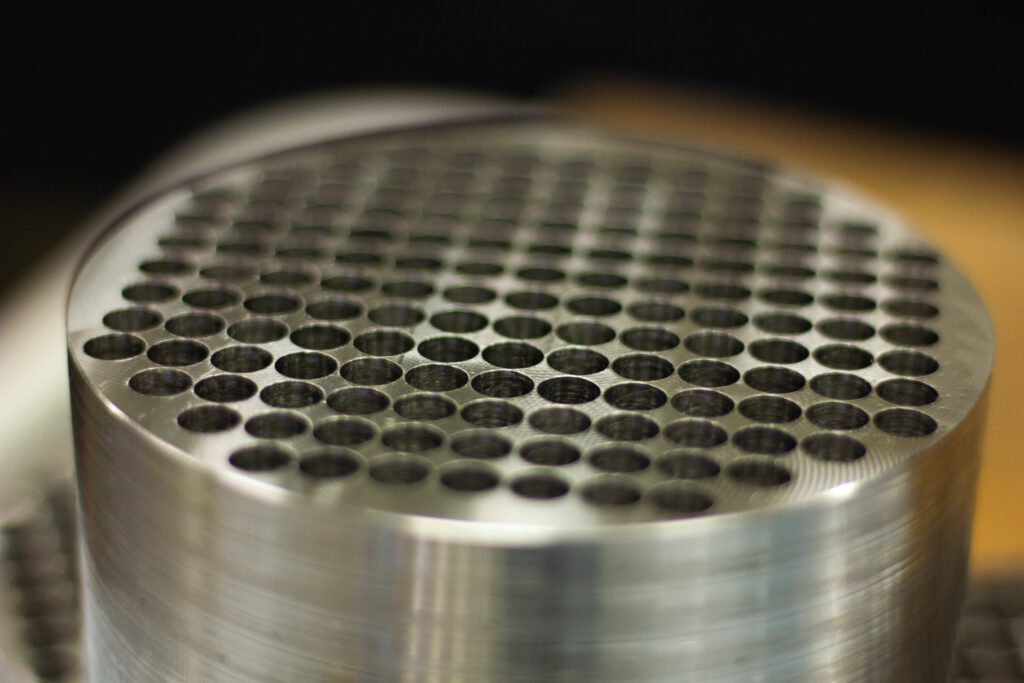

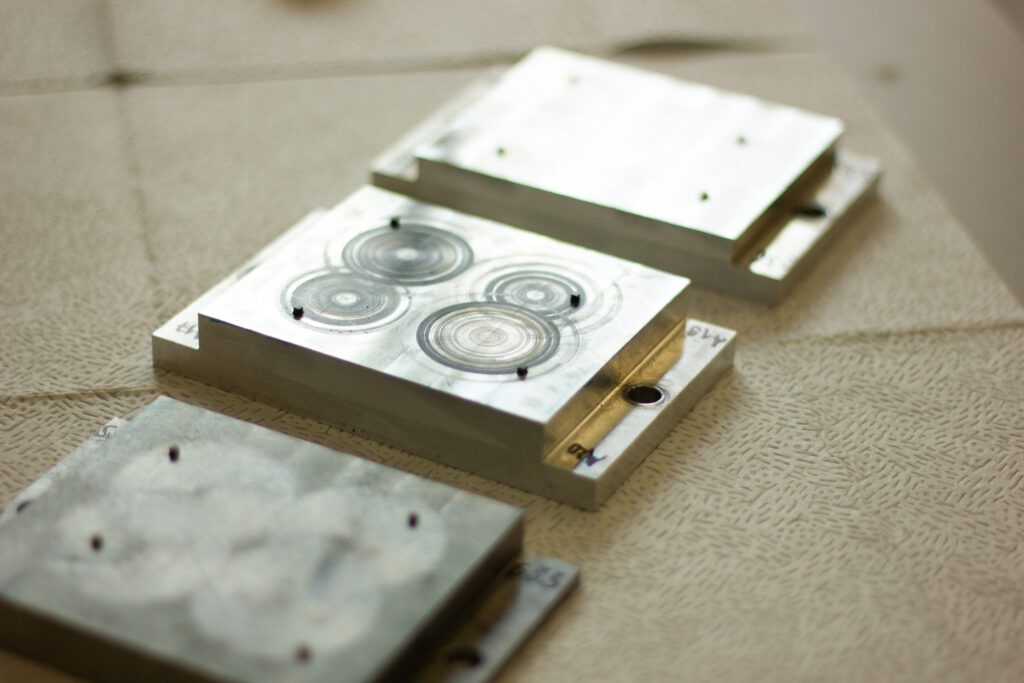

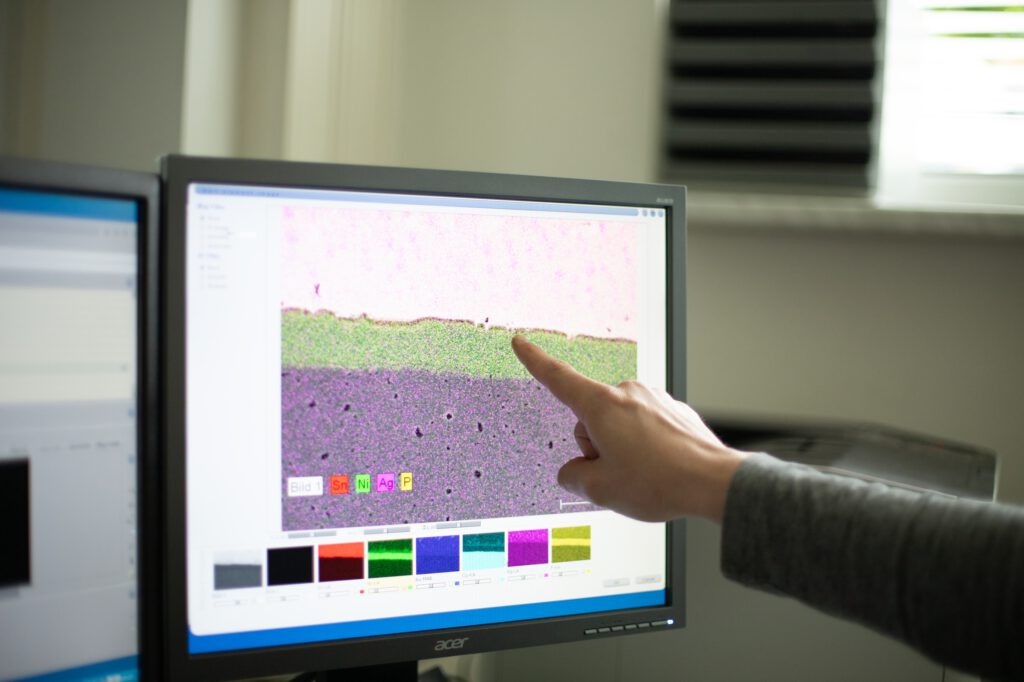

Fertigende Unternehmen brauchen spezifische und hochpräzise Anlagen zur Vermessung ihre Werkzeuge, Bauteile und Produkte. Um eine Produktion möglichst reibungslos ablaufen zu lassen, ist eine Kontrolle von Nöten, die sich in die Produktionsabläufe einlässt. Das Unternehmen PREMETEC aus Suhl widmet sich seit mehr als 30 Jahren dieser Hausforderung und stellt für die Industrie hochwertige Lösungen für das Messen, Prüfen und Automatisieren bereit. Als ein Komplettanbieter für passgenaue Messvorrichtungen und unter anderem von Prüfautomaten entwickelt und fertigt das momentan 27-Mitarbeiter:innen starke Unternehmen für jeden Einzelfall optimierte Lösungen. Die Stückzahl der Produkte beläuft sich dabei zumeist auf eins, was die hohe Spezialisierung und Passgenauigkeit der Produkte greifbar macht.

Neben der Automobilbranche und dessen Zulieferpartnern werden zunehmend Unternehmen aus den Branchen wie der Medizintechnik, der Sicherheitstechnik und der Konsumgüterproduktion zu Abnehmern dieser Vermessungstechnologien. Das Portfolio von PREMETEC umfasst dabei neben kompakten und integrierten Lösungen auch spezielle Messstände, Messzellen und Prüfstände. Ab von der eigentlichen Vermessung ist eine Herausforderung für Messtechnologien, sich reibungslos innerhalb von Produktionsabläufen zu integrieren. Ein Produktionsintervall von einer Minute bedingt, dass auch die Prüfung unter einer Minute bleibt. Je nach Anwendungsfall und Vermessungsaufwand ist dies dann mehr oder weniger diffizil.

Die Industrie steht selbst vor Herausforderungen, was auch Folgen für Unternehmen wie PREMETEC zeitigt. Kleiner werdende Stückzahlen sind Folge dynamischer werdender Produktionszyklen, wodurch die hochspezialisierten Messtechnologien einem höheren Rentabilitätsdruck ausgesetzt werden, und worauf die Branche reagieren muss. Eine Lösung könnte sein, die Messtechnik in einem gewissen Rahmen variabel zu gestalten, und so für mehrere Produkte nutzbar zu machen. Beispielhaft sei auf eine Druckgussbauteil einer Heckklappe verwiesen, die selbst eine komplexe Geometrie aufweist und die zugleich sehr exakt gefertigt sein muss, um den Toleranzrahmen der Abweichungen nicht zu sprengen. Die akute Frage ist also, ob es eine Möglichkeit gibt, bei kleinen Varianzen im Design nicht die komplette Messtechnik ersetzen zu müssen.

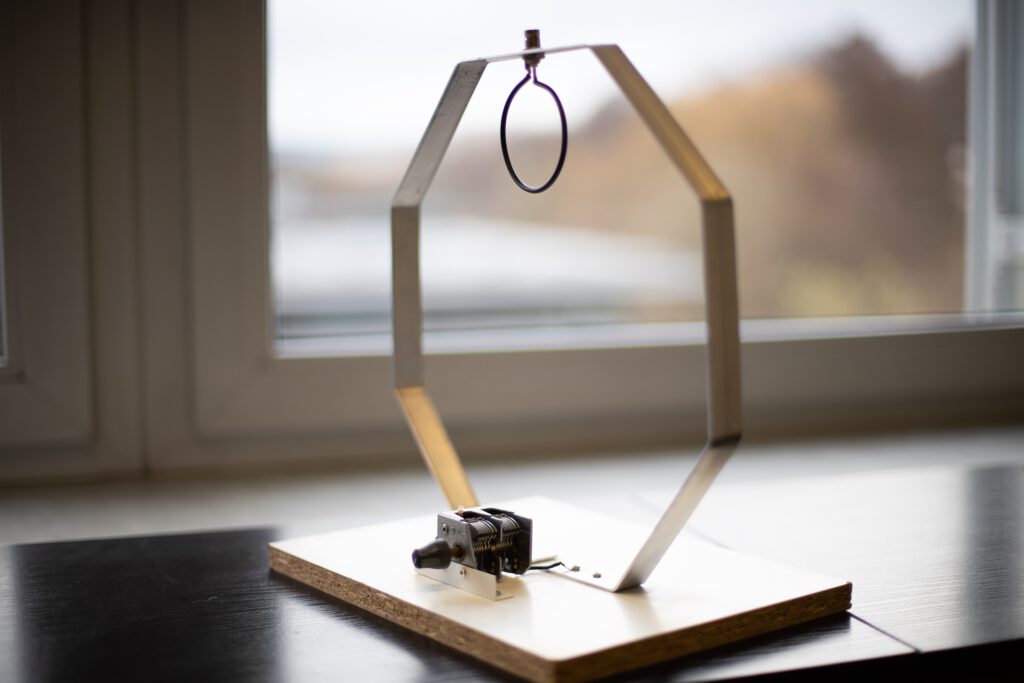

Eine der zentralen Herausforderungen ist es dabei, die hohe Qualität bei Präzision und prozessualer Integration bei einer gleichzeitig gestatteten Flexibilität für variable Anwendungen garantieren zu können. Eine Lösung könnte in der Integration von Cobots bestehen, die in einem modularen Aufbau einer Messvorrichtung für unterschiedliche Vermessungsaufgaben genutzt werden könnten. Gerade preisgünstige Modelle würden es klein- und mittelständischen Unternehmen, wie sie Thüringen kennzeichnen, ermöglichen, auf diese Lösungen zurückgreifen zu können. Das Thema des Forschungsvorhabens und der Kontext seiner Anwendung stehen uns nun vor Augen. Offen hingegen sind noch die Arbeitspakete der Hochschule, also mit welchen Schwerpunkten sie sich in das Vorhaben einbrachte.

Cobots zwischen Kooperation und Korrektur

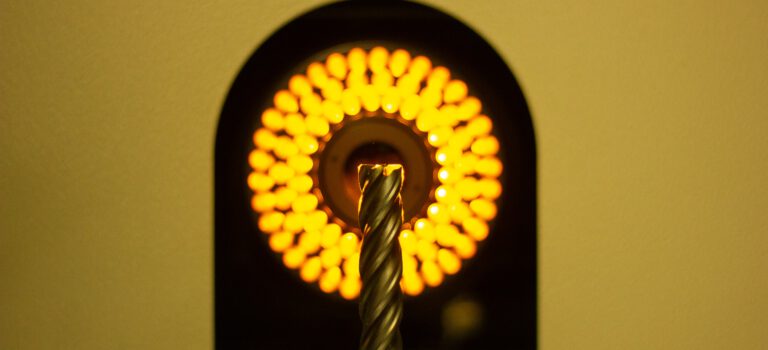

Vorab lässt sich festhalten, dass sich die Hochschule mit den Themen der Vermessung der Präzision des Cobots und den Möglichkeiten der Korrektur befasste. Mit Nikhil Meduri und Niranjan Kannali Ramesha erarbeitete ein Team aus dem Lehrstuhl „Professur für Antriebs-, Automatisierungs- und Robotertechnik“ von Professor Frank Schrödel in und zusammen mit PREMETEC über das Jahr Projektlaufzeit eine Lösung für diese Aufgabe. Das Projekt der Hochschule ließ sich in drei Arbeitspakete aufteilen, wobei sich die beiden letzten Pakete verknüpfen lassen. Für die Vermessung der Präzision des Roboters ist es wichtig zu bedenken, dass es sich um einen Low-Cost-Cobot handelt, und keine für solche Aufgaben ausgelegten Spezialvariante. Eine Folge dieser Grundbedingung ist, dass detaillierte Statistiken über das Verhalten und die Präzision des Roboters speziell im Dauerbetrieb bislang fehlten. Dieser Aufgabe hat sich die Hochschule angenommen.

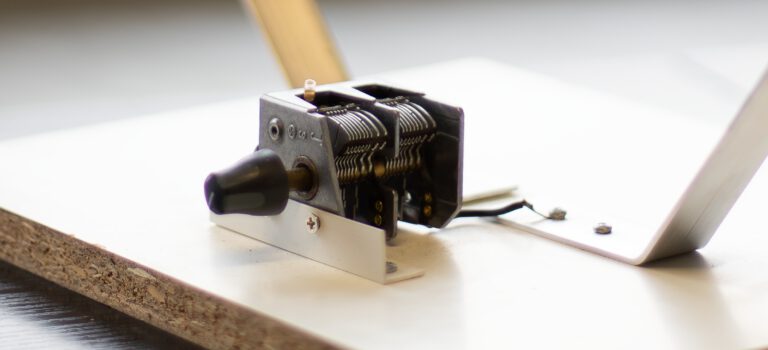

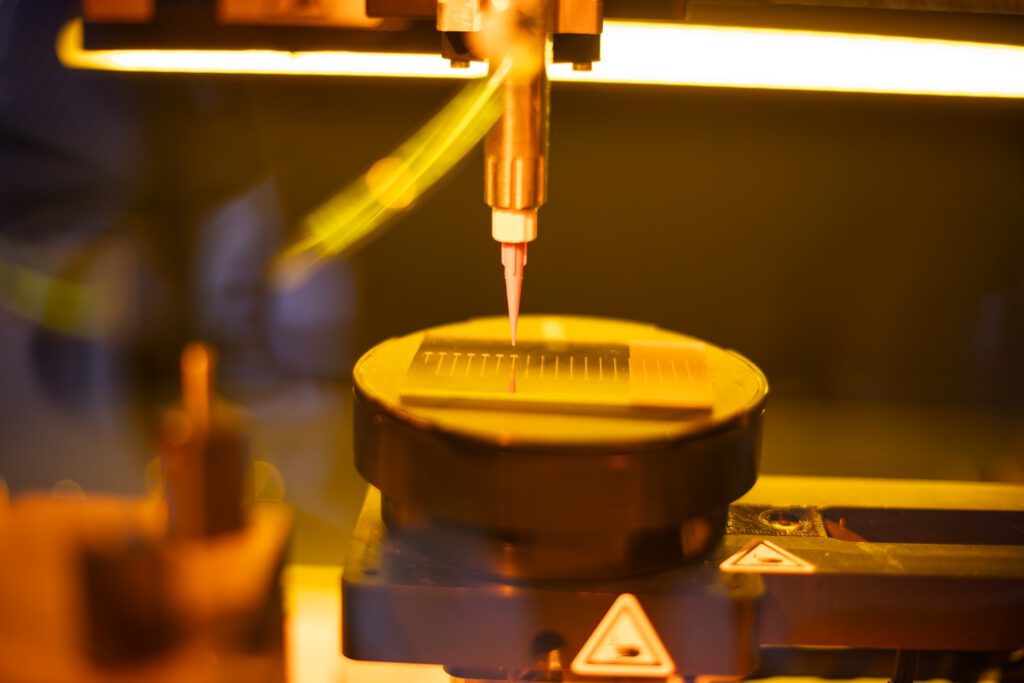

Das erste Arbeitspaket befasste sich mit der Konzeptionierung des Projektes und seiner organisatorischen Koordination. Gerade weil die Laufzeit mit einem Jahr für die ambitionierten Aufgabenstellungen recht kurz bemessen war, die Abklärung der Grundstruktur ein wichtiger Aspekt. Zu unterscheiden war mit dem Sensorbereich inklusive Messkopf und Messtaster sowie dem Aktorbereich, also dem Robotor. Insbesondere musste die Kommunikation zwischen den Komponenten untersucht werden und ein Fokus auf die Ungenauigkeit der Robotorpositionierung geworfen werden. Kurzum ging es um die Frage, ob es Fehler bei der Positionierung gab und ob sich diese innerhalb einer tolerierbaren Größenordnung bewegten.

Im Zentrum des zweiten Arbeitspaketes stand neben der Entwicklung einer Steuerungsplattform auch die Erprobung, also die Übersetzung in die Wirklichkeit. Als Problem erwies sich dabei einerseits die mit der Bewegungskomplexität steigende Ungenauigkeit des Robotorarms: Je mehr Gelenke des Arms im Zuge einer Dreh- oder Greifbewegung aktiviert wurden, umso unpräziser wurden die Abläufe. Andererseits war die Sicherstellung der Wiederholgenauigkeit im Dauerbetrieb ein Gegenstand der Untersuchung. Der Robotorarm wurde unter anderem 600 mal an derselben Stelle positioniert, wobei sich im Laufe des Verfahrens eine immer höhere Ungenauigkeit ergab. Mit diesem Wiederholungspositionierungstest und der Analyse der Daten konnte sich das Schmalkalder Team einen weit umfassenderen Kenntnisstand über das Realverhalten des Robotorarms erarbeiten als dies Seitens des Herstellers bislang verfügbar war.

Diese Daten braucht es, um die Eignung des Arms für Messungen abschätzen zu können. Zugleich ist es wichtig im Kopf zu behalten, dass die wiederholte Selbstpositionierung nicht zum klassischen Repertoire dieser Roboter gehört, sondern eher die Repetition von Bewegungsabläufen. Dennoch ist die Kenntnis der Fehlerrate entscheidend für Einschätzung der Eignung der Roboter und die mögliche Nutzung der Low-Cost-Cobots. Nach der Untersuchung des Verhaltens war die Korrektur der Fehler der nächste Schritt. Als ein Problem stellte sich der postfaktische Eigensinn des Roboterarms heraus, der entgegen der objektiven Faktizität davon ausging, sich an der richtigen Stelle zu befinden. Die Frage war nun, wie sich das Verhalten des Robotors korrigieren ließe.

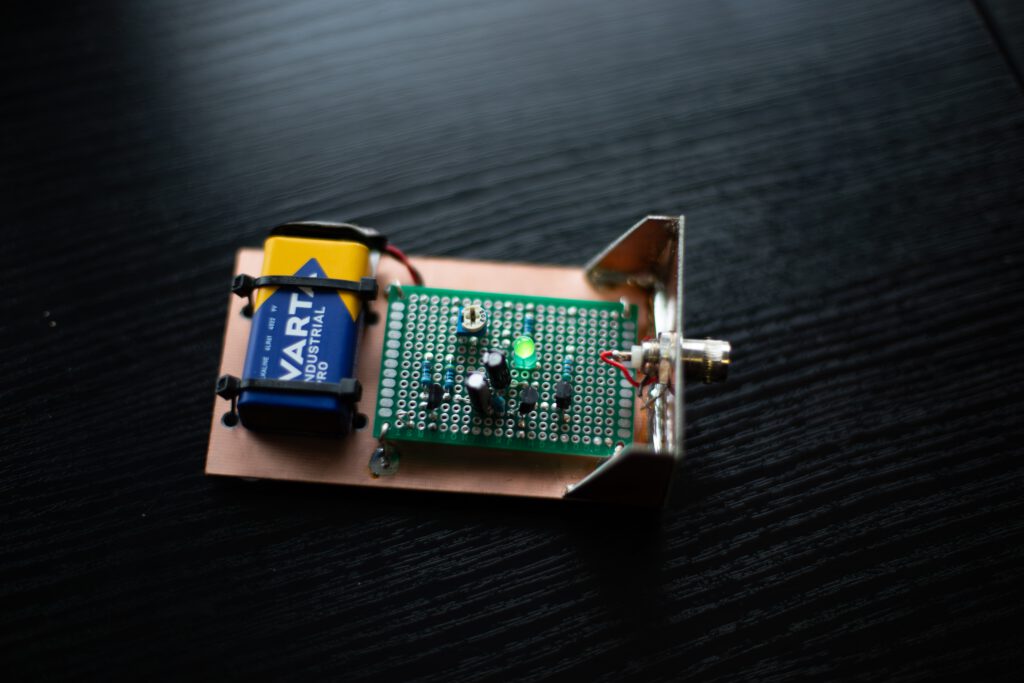

Die Lösung bestand in der Nutzung eines selbst entwickelten 6-stufigen Algorithmus: Mittels dieser adaptiven Softwarelösung konnte die Abweichung ausgeglichen werden, ohne dass aufwändige mechanische Eingriffe nötig gewesen wären. Den hohen Ansprüchen an Präzision, wie sie sich durch die Nutzung im Rahmen der Messtechnik stellten, konnte mit dieser Lösung über eine Korrekturmatrix ebenso entsprochen werden wie der funktionalen Adaptierbarkeit, also einer bleibenden Flexibilität in der Anwendung der Messtechnik. Dem entspricht auch, dass die Komponenten, die zur Korrektur notwendig sind, extern bleiben und nicht im System selbst fixiert oder implementiert sind. So bleibt diese Machine-Learning-Lösung autonom und adaptiv, was ihrer weiteren Nutzung viele Möglichkeiten bietet.

Transfer und die kommunale, föderale und supranationale Kooperation

Der in der Überschrift notierte Paradigmenwechsel besteht darin, dass die Cobots nicht mehr nur Hilfsinstrumente zur Vermessung sind, sondern selbst zur aktiven Vermessung genutzt werden. Eine Bedingung hierfür ist die Präzision, die durch das 3D-FMM-Projekt ermöglicht wurde. Gerade weil präzise Handhabungsaufgaben in der Industrie immer relevanter werden, birgt dieses Projekt auch immense Möglichkeitsräume für die weitere Nutzung. Im Sinne des Transfers lassen sich Potentiale nutzen, auf Seiten der Hochschulen ebenso wie auf Seiten der Unternehmen wie PREMETEC und der Hersteller der Cobots.

Die Relevanz und den erwartbaren Impact des Projektes für den Wirtschaftsraum Thüringen wurde auch an der Förderung durch den „Europäischen Fonds für die regionale Entwicklung“ und der Thüringer Aufbaubank (TAB) deutlich. Neben Holger Haun von der TAB stand auch Dr. Sebastian Stark auf der Gästeliste des Abschlussevents, wobei letzterer die Referatsleitung der Technologieförderung im Thüringer Ministerium für Wirtschaft, Landwirtschaft & Ländlichen Raum innehat. Mit Ariane Winkler und Sebastian Poppner war zudem auch die kommunale Wirtschaftsförderung des Oberzentrums Südthüringen vor Ort. Die Erfahrungen in der Transferbeziehung, die Hürden und Schwellen, die die Projektpartner gemacht haben, können durch dieses Netzwerk weitergetragen werden und können den Weg weiterer Forschungskooperationen ebnen.

Im Sinne eines gegenseitigen Gewinns hatte das Kooperationsprojekt für die Beteiligten Vorteile: Für das Unternehmen bietet sich eine fast marktreife Technologie, die das bestehende Portfolio sinnvoll erweitert. Für die Hochschule bot sich eine Möglichkeit anwendungsnaher Forschung, die neben Erkenntnissen und konkreten Daten auch zu mehreren Veröffentlichungen führte. Und nicht zuletzt wurde in dem Projekt ein Erfolgsmodell gezeigt, wie sich internationale Studierende in klein- und mittelständisch geprägte Unternehmen produktiv einbringen können. So konnten schlussendlich viele Potentiale genutzt werden.