Die Zahl an Studienabbrüchen ist seit Langem hoch, gerade in den ersten Jahren geben viele Studierende ihr Studium vorzeitig auf. Die Gründe für diese Entscheidungen sind vielfältig und lassen sich nicht verallgemeinern. Auf der einen Seite beruhen sie auf gewonnenen Erfahrungen mit den jeweiligen Fachbereichen: Die individuelle Einsicht darin, dass Fachgebiete oder Methoden den eigenen Präferenzen nicht entgegenkommen, führt dazu, das Fach zu wechseln oder gänzlich andere Wege zu gehen. Andere Gründe für den Abbruch des Studiums sind dagegen vermeidbar: So stellt der Wechsel von der schulischen hin zur universitären, höheren Bildung viele junge Menschen vor Herausforderungen. Neben dem Umfeld ändern sich auch die Ansprüche an die Organisationsfähigkeit, das selbstständige Lernverhalten und nicht zuletzt die Komplexität der vermittelten Inhalte. Hier könnte eine mobile Lern-App Abhilfe schaffen.

Institutionen wie Hochschulen ist daran gelegen, die Zahl vermeidbarer Studienabbrüche zu minimieren. Eine mögliche Antwort holt die Studierenden gezielt in ihrem Alltag ab: Die Nutzung von mobilen Endgeräten ist aus dem Leben junger Erwachsener nicht mehr wegzudenken. Smartphones dienen nicht mehr nur allein der Kommunikation, sondern neben der Organisation und Navigation nun vermehrt auch dem Banking und vielen anderen Dingen. Kurzum: Die Geräte sind Teil des Alltags und der Umgang mit ihnen ist ebenso häufig wie intensiv. Anhand dieses Befundes lassen sich durchaus Potentiale absehen, die es nahelegen, diese Geräte zu nutzen, um Studierende zu unterstützen. Es stellt sich mithin die Frage, ob und wie sich eine mobile Lernapplikation dazu eignen könnte, die Anfangsphase des Studiums und seine Herausforderungen für die Betroffenen zu erleichtern und somit den Abbruch eines Studiums zu verhindern.

Von der Konzeption eines Anforderungsprofils…

Professor Florian Johannsen begann bereits in seiner Zeit an der Universität Bremen mit einem Team eine entsprechende App für den Bereich Wirtschaftswissenschaften zu entwickeln. Auch nach dem Antritt seiner Professur für Betriebliche Anwendungssysteme an der Fakultät für Informatik der HSM ist er weiter Teil dieses Projektes an der Bremer Universität. Auf Seiten des Lehrstuhls für Allgemeine Betriebswirtschaftslehre, Unternehmensrechnung und Controlling (Universität Bremen) besteht das Projektteam neben Professor Jochen Zimmermann, Dr. Martin Kipp, Dr. Johannes Voshaar und M.Sc. Janik Ole Wecks auch aus den Kollegen Prof. Thomas Loy (mittlerweile Universität der Bundeswehr München) sowie dem studentischen Mitarbeiter Patrick Heusmann. In mittlerweile fünf Publikationen präsentieren die Forschenden unterschiedliche Etappen der Entwicklung und folglich auch verschiedene Stufen der Implementierung der App „WiWiNow“.

Am Anfang stand die Frage, worin die Gründe für Studienabbrüche liegen und was die spezifischen Bedürfnisse und Herausforderungen von Studierenden am Beginn ihrer akademischen Laufbahn sind: Was sind die individuellen Motive und Situationen, die den Ausschlag für den Abbruch geben? Und wie kann ein App die Studierenden unterstützen, welche Funktionen und Features muss sie bieten? Wichtig ist hierbei die Einbeziehung der Betroffenen, da es genau um ihre Erfahrungen geht und sie am besten Auskunft darüber geben können, welche Angebote nicht nur nützlich wären, sondern auch tatsächlich genutzt werden. Dieser Punkt ist so trivial wie relevant: Beim Design einer App ist nicht nur die Funktionalität und die Usability zu beachten, sondern auch die Wahrscheinlichkeit einer regelmäßigen Nutzung. Es geht darum, die App als aktiven Teil in den Alltag zu integrieren, und so die nützlichen Effekte zu potenzieren. Aber der Reihe nach…

Am Beginn stand die empirische Evidenz, dass nicht nur der Bildungshintergrund einen Einfluss auf Erfolg und Misserfolg der höheren Bildungswege hat, sondern auch schlechte Erfahrungen im Studium selbst sowie psychologische Faktoren wie ineffiziente Lernstrategien oder der Mangel an Selbstorganisation (Vgl. Johannsen et al. 21, S. 1). Diese Kompetenzen werden in der Hochschulbildung vorausgesetzt, was einen großen Unterschied zum schulischen Kontext darstellt. Zugleich sind sie für so manchen Studierenden das umgangssprachliche Neuland. Die Abbruchquoten sind in der ersten Phase vergleichsweise hoch, zugleich haben Studien mit Blick auf das deutsche Bildungssystem einen Mangel an sozialer und akademischer Integration festgestellt, der zu den vermehrten Abbrüchen führt (Vgl. Johannsen et al. 23, S. 636f.). Diesen Herausforderungen der Transition-in-Phase[1] könnte eine App Abhilfe verschaffen, die nicht nur dazu dient, Seminar- und Vorlesungstermine zu koordinieren, sondern auch das Lernverhalten trackt und transparent macht sowie Wissen durch Übungen vertieft und über spielerische Elemente abruft.

… zur Entwicklung einer App…

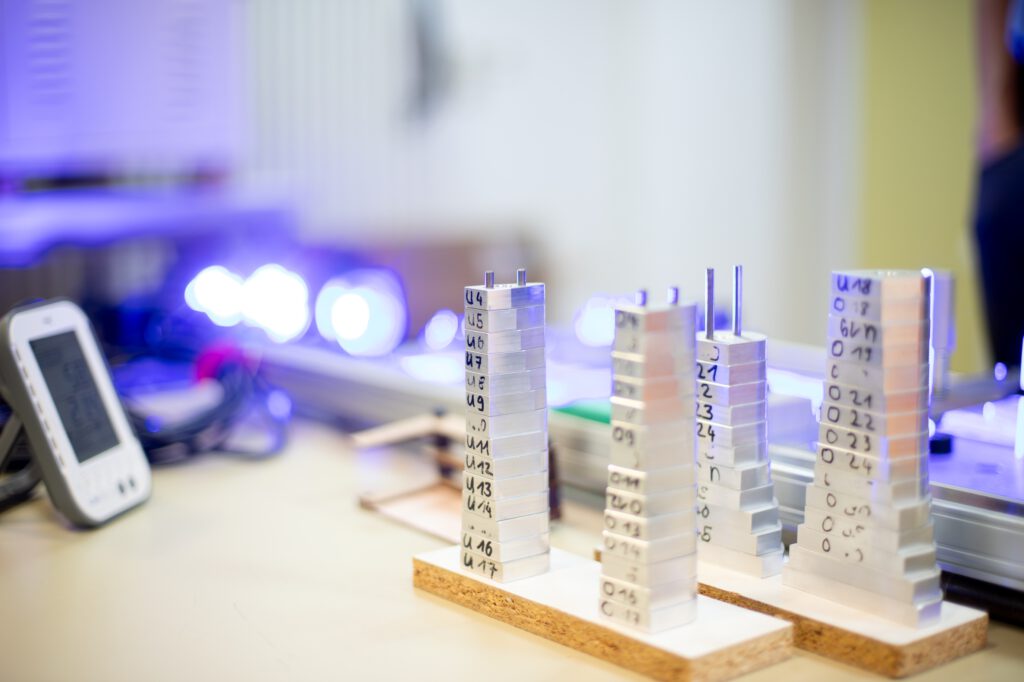

Die erste Phase des Projektes befasste sich mit der Konzeption eines Prototyps anhand spezifischer Design-Vorgaben und mit der Taxierung eines technischen Rahmens: Die Fixierung von drei Meta-Anforderungen wurde in acht Design-Anforderungen überführt, welche die App erfüllen muss (Vgl. Johannsen et al. 23, Fig. 2, S. 639). Es ging also darum zu klären, was die App liefern soll, und was die beste technische Lösung wäre. Nach einer ersten Orientierung über das Design der Anwendung und einer Übersicht über die am Markt befindlichen Alternativangebote wurde eine Gruppe Studierender befragt, die sich im zweiten oder dritten Studienjahr befanden: Die Idee war, von deren Erfahrungen der Herausforderungen zu lernen, etwaige Lösungswege zu eruieren und schließlich Anforderungen an die App einzuholen. Eine zweite Umfrage zielte auf eine Gruppe von Lehrenden, die in engem Kontakt zu den Studierenden stehen und mit ihren Problemen vertraut sind. Zugleich verfügen sie über einen reichhaltigen Erfahrungsschatz des akademischen Alltags. Anhand dieser beiden Usergruppen wurden User Journeys beschrieben, also wie mögliche Anwender:innen mit der App umgehen und wie sie durch sie geleitet werden. Anhand des Prototyps konnten dann verschiedene Testphasen vollzogen werden, und sowohl das Front- als auch das Backend verbessert werden.

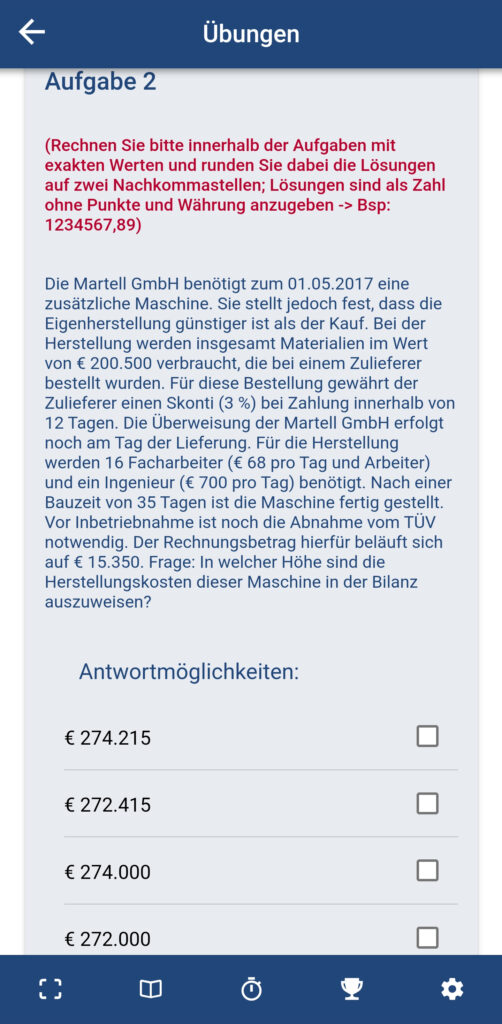

Nun war der Zeitpunkt da, die App unter realen Bedingungen zu testen. In einem verpflichtenden Einführungskurs zum Rechnungswesen im Wintersemester 2020/21 wurde die App den Studierenden zur Verfügung gestellt. Um Verzerrungen zu vermeiden, gab es keine Gratifikationen für die Teilnahme an der Studie. Wichtig zu erwähnen ist noch der Umstand der Pandemie und die Folge, dass der Lehrbetrieb ins Digitale verschoben wurde – was natürlich die Testbedingungen veränderte. Von den Teilnehmenden wurden sozio-demografische und strukturelle Daten abgefragt, die in die spätere Auswertung einfließen sollten. Hinzu kamen die Daten der App-Nutzung (u.a. Dauer der Nutzung und Quiz-Performanz), die Daten der Kursteilnahme (neben dem Kurs auch das begleitende Tutorium) und der akademischen Performanz (die Prüfungsleistung). Selbstredend wurden die Daten anonymisiert und dem Datenschutz genüge getan. Am Ende konnten die Daten von 575 Teilnehmenden in die Studie aufgenommen werden (Vgl. Voshaar et al. 22, S. 7).

Im Ergebnis ließ sich festhalten, dass sich ein intensiverer Gebrauch der App signifikant positiv auf das Prüfungsergebnis auswirkt. Gerade weil die höhere Nutzung der App auch mit Faktoren der Besuche der Vorkurse und der Tutorien positiv korrelierte – und folglich unklar war, was der entscheidende Faktor der Leistungssteigerung war –, wurden weitere Untersuchungen nötig. Mit anderen Worten: Es blieb offen, ob die Nutzung der App selbst positive Effekte hatte oder ob leistungsstärkere bzw. motiviertere Studierende die App eher von sich aus nutzten, was den Einfluss der App verringern würde (Vgl. Voshaar et al. 22, S. 14). Nach der Korrektur mit Hilfe einer Kontrollvariable, die auf die Einflussfaktoren der Selbst-Selektion abgestimmt war, haben sich die ersten Ergebnisse aber als robust erwiesen. Nach diesen durchaus positiven Befunden konnten die Forschungen um die App weitergeführt werden.

… über die Bestimmung von Qualitätsdimensionen der Nutzung …

Ein weiterer Ansatz, der zu einer Veröffentlichung geführt hat, befasst sich mit den verschiedenen Qualitätsdimensionen der Akzeptanz, die eine Anwendung aufweisen kann und die mit ihrer Nutzung einhergehen. Hierbei wurden vier Qualitätsdimensionen ausgemacht, die von der App bedient werden sollten und die wiederum selbst in Unterkategorien aufgegliedert werden können: Geht es in der Systemqualität um die Art und Weise, wie die Informationen durch eine App aufbereitet werden, zielt die Servicequalität auf die angebotene Unterstützung ab. Die Informationsqualität wiederum umfasst die Evaluation der ausgegebenen Inhalte, wogegen die Qualitätsdimension des wahrgenommenen Vergnügens (perceived enjoyment) bei der Nutzung ebenso selbsterklärend wie eine für die Wiedernutzung relevante Kategorie ist (Vgl. Johannsen et al. 23, S. 641 – 644). Mit der Intension der Wiedernutzung und der wahrgenommenen Nutzer:innenzufriedenheit (perceived user satisfaction) schließen sich dann zwei Aspekte aus der User-Perspektive an, die wiederum mit unterschiedlichen Qualitätsdimensionen gekoppelt werden können und zugleich beide auf die Lerneffektivität als letzten Aspekt Einfluss haben.

Ein Ziel im Design der App war es, die Funktionalität und den Komfort kommerzieller Apps in der Strukturierung des Alltags mit universitätsbezogenen Inhalten, organisatorischen Funktionalitäten und spielerischen Elementen zu kombinieren (Vgl. Johannsen et al. 23, S. 638f.). Mit Hilfe der unterschiedlichen Qualitätsdimensionen lassen sich Stärken und Schwächen in der Nutzer:innenfreundlichkeit eruieren, was wiederum die Implementierbarkeit in den Alltag zumindest indirekt erhellt.

Im Ergebnis wurde eine Umfrage zu den Erfahrungen der Nutzung ausgewertet, an der sich zum Semesterende 131 Studierende beteiligten, wobei das eigentliche Sample aus unterschiedlichen Gründen (z. B. unvollständige Datensätze) 113 Studierende umfasste. In diese Auswertung flossen die vermerkten Qualitätsdimensionen ein, die in unterschiedlichen Items abgefragt wurden. Die System- und die Informationsqualität sowie die Qualitätsdimension des wahrgenommenen Vergnügens fördern die Nutzer:innenzufriedenheit, wobei die letzte Qualitätsdimension auch die Intension zur Wiedernutzung verstärkt. Die Lerneffektivität wird wiederum durch die Nutzer:innenzufriedenheit und die Intension positiv beeinflusst. Anhand dieser Daten konnte das Design der App und seine Erfüllung der Anforderungen überprüft und justiert werden (Vgl. Johannsen et al. 23, S. 651ff.). Ferner konnten vier spezifische Designprinzipien formuliert werden, die eine App bezogen auf die Transition-in-Phase beachten sollte: Neben einer Teilnahme-Management-Funktion bedarf es einer Kontrollfunktion des selbstständigen Lernens. Zudem muss eine plattformübergreifende Zugänglichkeit gegeben sein und die Inhalte einfach zu organisieren sein (Vgl. Johannsen et al. 23, S. 655f.).

… über die Verbesserung des Lernverhaltens …

In einer weiteren Studie, die auf der 44. Internationalen Konferenz zu Informationssystemen (International Conference on Information Systems – ICIS) in Hyderabad vorgestellt wurde, wird der Versuch unternommen, die App an etablierten Ansätzen der Lerneffektivität zu messen. Zwar wurde eine Verbesserung der Noten in den Abschlussprüfungen bereits nachgewiesen, dieser Aspekt ist aber nur ein Teilbeitrag zum Ziel, die Abbruchsquoten des Studiums zu senken. Das Konzept der fünf Erfolgsfaktoren studentischen Erfolgs hat Lizzio (2011) bezogen auf die Transition-in-Phase entwickelt: Die Erfolgsfaktoren sind die Verbundenheit (connectedness) z.B. mit dem akademischen Leben, die Fähigkeit (capability) der Selbstorganisation u.a., die Sinnhaftigkeit (purpose) z.B. akademischer Praxen, der Einfallsreichtum (resourcefulness) in der Koordinierung verschiedener Anforderungen und die Kultur (culture) im Sinne einer Wertschätzung der höheren Bildung. Der zweite Ansatz differenziert unterschiedliche Lernmodelle mit je eigenen Charakteristika: Neben dem oberflächlichen Lernen kann das strategische und zuletzt das tiefe Lernen angeführt werden (Vgl. Voshaar et al. 23, S. 3f.). Bleibt das erste Lernverhalten unfokussiert und ephemer, unterwirft sich das zweite Modell der Maxime der Effizienz und spricht dem Gelernten selbst keinen Eigenwert zu. Das tiefe Lernen wiederum lässt sich am ehesten als eigenständige Durchdringung der Wissensbestände erklären. Ziel war es zu erfahren, ob die App bzw. bestimmte Elemente helfen, die Herausforderungen der Transition-in-Phase zu meistern.

Die Auswertung der Studie ergab, dass die Nutzung der App die Sinne der Fähigkeit und des Einfallsreichtums positiv beeinflussen kann. Zudem verstärkt es das strategische und mindert das oberflächliche Lernverhalten. Die App hilft demnach bei der studentischen Selbstorganisation, fördert das eigenverantwortliche Lernen und die Einsicht in institutionelle Anforderungen in der höheren Bildung. Diese Potentiale sollten sich nutzen lassen, um die Quoten der Studienabbrüche zu verringern, werden Studierende doch über Angebote der App bei den ausgemachten Herausforderungen in der Anfangsphase des Studiums unterstützt.

In Kombination mit analogen Unterstützungsangeboten vor Ort haben die verschiedenen Komponenten der App unterschiedliche Potentiale der Unterstützung, die von der Selbstorganisation über die Prüfungsvorbereitung bishin zur Ausbildung einer studentischen Identität reichen. Gerade weil Defizite an effizienten Lernstrategien und dem Zeitmanagement enorme Potentiale an Frustration bergen, kann hier die App produktive Akzente setzen. Nicht zuletzt dienen die spielerischen Elemente der App der Motivation zur Wiedernutzung. Somit kann die App nicht nur die abgerufene Prüfungsleistung verbessern, sondern auch andere Impulse der Unterstützung setzen, die neben dem Lernverhalten auch die Selbstorganisation betreffen.

… bis zur Differenzierung verschiedener App-Features

In der jüngsten Studie befasst sich das Bremer Team zusammen mit Florian Johannsen mit der Frage, ob sich die einzelnen Komponenten der App anhand ihrer Effektivität differenzieren lassen. Diese Studie wurde auf der 45. Internationalen Konferenz zu Informationssystemen (International Conference on Information Systems – ICIS) in Bangkok vorgestellt. Zunächst konnte bestätigt werden, dass App-Nutzende ein signifikant besseres Ergebnis in den Prüfungen haben. Eine Unterteilung in verschiedene Nutzungstypen (Übungen, Quizze und Selbstorganisation) ergab keine nennenswerten Unterschiede hinsichtlich einer Verbesserung der Prüfungsleistung.

Die anschließende Forschungsfrage war, ob die Komponenten der App die Anforderungen und die Prinzipien des Designs unterschiedlich gut unterstützen. Festhalten lässt sich zunächst, dass alle drei App-Features die Leistung positiv unterstützen, mit einer Ausnahme: Die Beantwortung komplexer Fragestellungen wurden durch das Quiz-Feature nicht signifikant positiv gefördert. Das ist auch durchaus plausibel, zielen die Quizze doch auf die Abrufung von Wissensbeständen, und nicht auf deren Anwendung in diffizilen Fällen ab.

Relativ lässt sich sagen, dass die Übungsfunktion den stärksten Unterstützungseffekt hat, der zugleich über die verschieden Fragetypen stabil bleibt. Bei den einfachen Fragekomplexen, die Standardwissen abriefen, waren auch die Quizze für die Studierenden hilfreich. Das Selbstorganisationsfeature trägt zwar ebenfalls zur Verbesserung der Prüfungsleistung bei, aber in geringerem Ausmaß. Die Studierenden in der konkreten Studie profitierten also am meisten von der Übungsfunktion, wobei die Quizzes ergänzend für den Aufbau von Wissensbeständen nützlich waren. Die Selbstorganisationsfunktionen haben zwar einen relativ geringen Mehrwert für die Prüfungsleistung, ihre positiven Effekte könnten aber auf andere Weise entstehen und eher die grundlegende Identitätsbildung der Studierenden betreffen. Durch den Abgleich mit den beiden Designaspekten lassen sich Empfehlungen für App-Entwickler:innen, Studierende und Lehrende formulieren (Vgl. Voshaar et al. 24, S. 13f.).

Viele Fragen sind noch offen, so wird auch die Erforschung der Nützlichkeit einer mobilen Lern-App weitergehen. Neben der Frage der Zweckdienlichkeit der organisatorischen Features und ihrer deskriptiven Abbildung können auch die Komponenten der App in ihren positiven Effekten weiter aufgeschlüsselt und differenziert werden. Gerade weil neue Technologien wie das Smartphone nicht mehr aus dem Alltag wegzudenken sind, ist die Implementierung einer mobilen Lern-App sinnvoll und ihre Erforschung geboten, auch um den Bedürfnissen nach ort- und zeitunabhängigen Angeboten gerecht zu werden. Es geht bei den verschiedenen Lehr- und Lernformen eben nicht um ein Verhältnis der Konkurrenz, sondern der Komplementarität, also der gegenseitigen Ergänzung. Die Digitalisierung setzt auch hier neue Impulse, die in Technologien wie einer Lern-App produktiv aufgenommen werden können.

Literatur (chronologisch sortiert)

- Lizzio, A. (2011), The Student Lifecycle: An Integrative Framework for Guiding Practice. Griffith University.

- Johannsen, F; Knipp, M; Loy, T; Voshaar, J; Zimmermann, J (2021): A mobile app to support students in the „transition-in“ phase. Proceedings of the 29th European Conference on Information Systems (ECIS 2021), Research-in-Progress Paper.

- Voshaar, J., Knipp, M., Loy, T., Zimmermann, J. and Johannsen, F. (2022), „The impact of using a mobile app on learning success in accounting education“, Accounting Education, Vol. No. pp. 1-26.

- Johannsen, F., Knipp, M., Loy, T. et al. (2023): What impacts learning effectiveness of a mobile learning app focused on first-year students?. Inf Syst E-Bus Manage (2023). https://doi.org/10.1007/s10257-023-00644-0

- Voshaar, J., Wecks, J.O., Johannsen, F., Knipp, M., Loy, T., Zimmermann, J. (2023): Supporting Students in the Transition to Higher Education: Evidence from a Mobile App in Accounting Education, Proceedings of the International Conference on Information Systems (ICIS 2023), Hyderabad, India.

- Voshaar, J., Johannsen, F., Mkervalidze, S. and Zimmermann, J. (2024). Unbundling the App Advantage: Evaluating Exam Performance-enhancing Features of Mobile Learning Apps in Accounting. International Conference on Information Systems (ICIS 2024). Bangkok.

[1] Die Transition-in-Phase ist eine Etappe des Studierendenzyklus nach Lizzio (2011). Dieser unterteilte das Studium in verschiedene, teils vor- und nachgelagerte Phase, in denen sich unterschiedliche studentische Identitäten je nach genuinen Herausforderungen, Aufgaben und Status ergaben.